[reinvent 2025] SageMaker & MLflow: 인프라 관리 없이 더 빠르게 혁신하는 방법

Summary

조직이 다수의 AI 모델과 에이전트를 구축하고 맞춤화함에 따라, 실험, 버전 관리, 평가를 관리하는 것이 점점 더 복잡해지고 있습니다. 본 세션에서는 금융 기술 분야의 선두주자인 Intuit이 Amazon SageMaker와 MLflow를 활용하여 AI 이니셔티브를 가속화하고, 팀이 AI 솔루션을 자신 있게 구축 및 배포할 수 있도록 지원하는 방법을 소개합니다. 인프라 관리 부담을 없애면서 포괄적인 실험 추적, 모델 평가 및 관찰 가능성을 제공하는 이 새로운 기능을 통해, 전통적인 ML부터 맞춤형 모델, 생성형 AI 애플리케이션, 미세 조정된 에이전트에 이르는 성장하는 AI 포트폴리오를 단일화된 환경에서 효율적으로 관리하는 방법을 배울 수 있습니다.

리인벤트 2025 테크 블로그의 더 많은 글이 보고 싶다면?

Overview

SageMaker Serverless MLflow로 ML 거버넌스 혁신하기

세션 개요

AI 거버넌스의 중요성

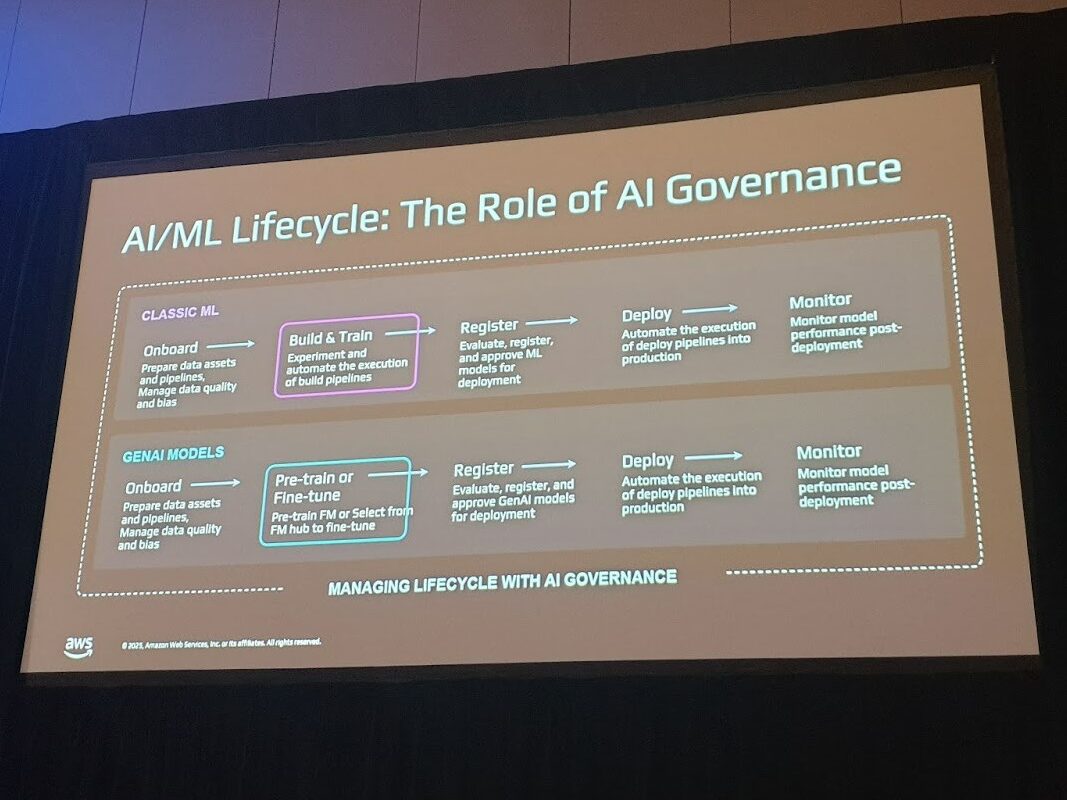

많은 AI 프로젝트 실패의 근본 원인은 모델이 잘못 구축된 것이 아니라 거버넌스 부족에 있습니다. 클래식 ML이든 GenAI 모델이든 온보딩, 훈련 또는 파인튜닝, 등록, 배포, 모니터링의 5단계 프로세스를 거치는데, 모든 단계에서 AI 거버넌스가 필요합니다.

거버넌스가 없으면 인프라 표준화의 부재로 인해 온보딩이 느려지고, 매번 인프라를 먼저 프로비저닝해야 하는 번거로움과 함께 보안 위험도 증가합니다. 전 세계에 분산된 팀이 효과적으로 협업하고, 실험과 데이터를 안전하게 공유하며, 설명 가능하고 재현 가능한 모델을 만들고, 감사 기능을 갖추려면 거버넌스가 필수입니다.

MLflow는 오픈소스 도구로, SageMaker는 관리형 MLflow 기능을 제공합니다. 추적 가능성과 반복 가능성 문제를 해결하여 데이터 사이언티스트든 감사자든 일관되게 동일한 결과를 제공합니다. CI/CD 파이프라인을 통한 패키징이 가능하고, 네이티브 모델 레지스트리 기능으로 전체 라이프사이클과 승인 프로세스를 추적할 수 있습니다.

Self-hosted MLflow의 한계

많은 고객이 로컬 머신에서 MLflow를 시작하는데 이는 PoC와 도구 익히기에는 좋지만, 세 가지 문제에 직면합니다.

첫째, 인스턴스 관리의 운영 복잡성입니다. 버전 업그레이드가 거의 매월 발생하고 이를 따라가는 것은 부담입니다.

둘째, SageMaker 보안, Studio IDE 등과의 통합 구축은 추가 오버헤드입니다.

셋째, 팀 규모가 커지고 사용 사례가 복잡해질수록 self-hosting의 총 소유 비용이 실제로 더 높습니다.

이것이 약 1년 반 전 SageMaker에서 완전 관리형 MLflow를 출시한 이유입니다. 원하는 IDE를 자유롭게 선택할 수 있고, 전용 도구가 내장되어 있으며, AWS 인프라에서 실행되어 안전합니다.

Serverless MLflow의 혁신

Serverless MLflow는 인프라 관리가 필요 없습니다. 크기 선택이 불필요하고 수요에 따라 자동으로 스케일 업/다운됩니다. 또한, 자동 버전 업그레이드입니다. MLflow는 오픈소스이고 버전 업데이트가 잦은데, Serverless MLflow는 하위 호환성을 보장하며 자동으로 모든 서버리스 인스턴스에 푸시됩니다. 그리고 DEV, QA, Production 같은 다단계 환경은 물론, 분산된 팀의 여러 개발 환경 전반에서 추적 서버와 가시성을 공유할 수 있는 기능을 제공하여 팀 간 협업을 더욱 원활하게 합니다.

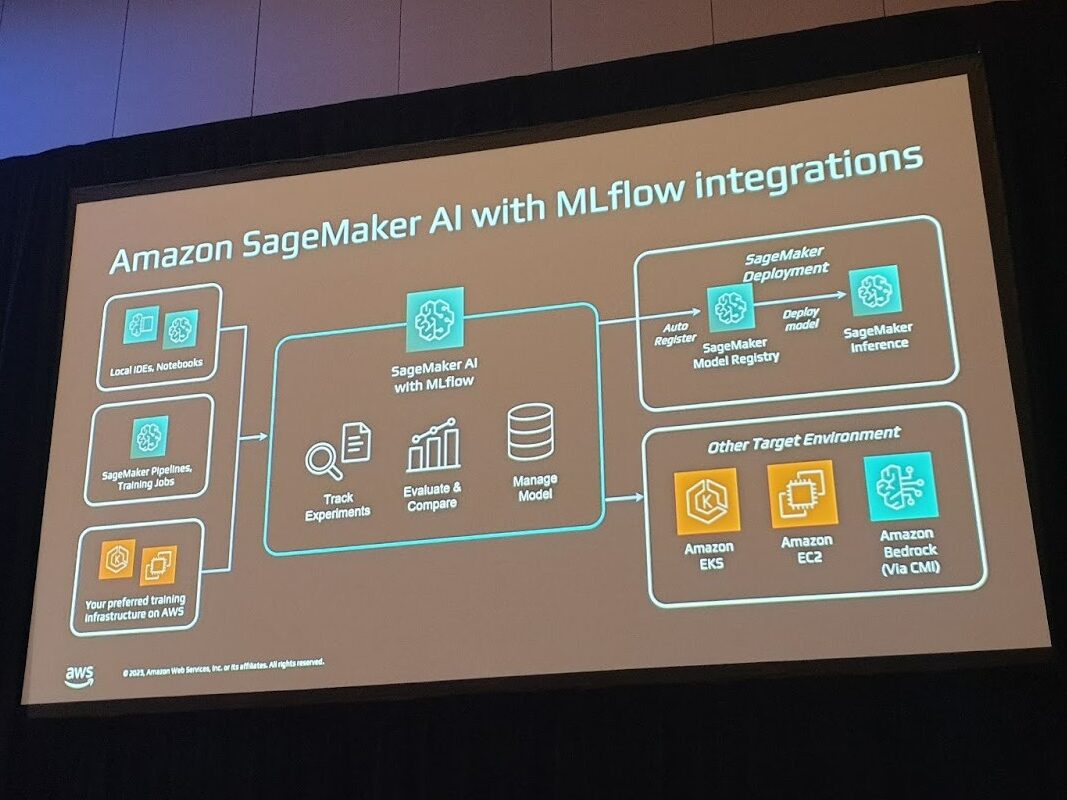

SageMaker 통합

Studio 내에서 MLflow가 완벽하게 통합됩니다. SageMaker Pipeline에서 훈련과 파인튜닝 중에 MLflow 앱이 자동 감지되고 모델 커스터마이징 기능에서도 고급 설정 아래 MLflow가 이미 선택되어 있고, 기본 MLflow 앱이 자동 감지됩니다.

새로운 MLflow UI는 기존과 완전히 다릅니다. 전통적인 ML뿐 아니라 GenAI 에이전트 추적도 지원합니다. 세션에서 시연된 IT 지원 예제 데모를 보면, 티켓 유형, 해결 방법, 정확도뿐 아니라 에이전트가 질문에 답하는 과정의 계보(Lineage)도 분석할 수 있습니다. 추적 가능성과 관찰 가능성 관점에서 상황을 진단할 수 있습니다.

결론 및 소감

이제 Serverless MLflow를 통해 인프라를 단순화 시켰습니다. 사용자는 크기 선택, 서버 시작과 중지, 업그레이드, 사용자 프로비저닝을 걱정할 필요가 없습니다. 또한, 데이터 사이언티스트는 실제 작업에 집중할 수 있습니다. VS Code, Pipeline, 모델 커스터마이징에서 기본 통합으로 MLflow나 추적 서버에 대해 걱정할 필요 없이 빠르게 작업할 수 있습니다.