[reinvent 2025] 생성적 AI 및 ML 워크로드를 위해 AWS 스토리지를 최적화하는 방법

Summary

딥러닝 프로그램을 프로덕션 환경으로 확장하는 것은 종종 어려움을 동반하며, 스토리지 성능과 확장성이 최적화되지 않으면 고품질의 데이터 모델링을 달성하기 어렵고 예상치 못한 비용 및 성능 문제로 이어질 수 있습니다. 본 인터랙티브 세션에서는 AI 및 ML 워크로드를 위한 스토리지 선택 및 최적화에 관한 질문에 대한 답변을 제공하여, 더 나은 모델을 구축하고, 더 빠르게 혁신하며, 대규모로 배포할 수 있도록 실질적인 도움을 얻을 수 있습니다.

리인벤트 2025 테크 블로그의 더 많은 글이 보고 싶다면?

Overview

Generative AI와 ML 워크로드를 위한 AWS 스토리지 최적화

세션 개요

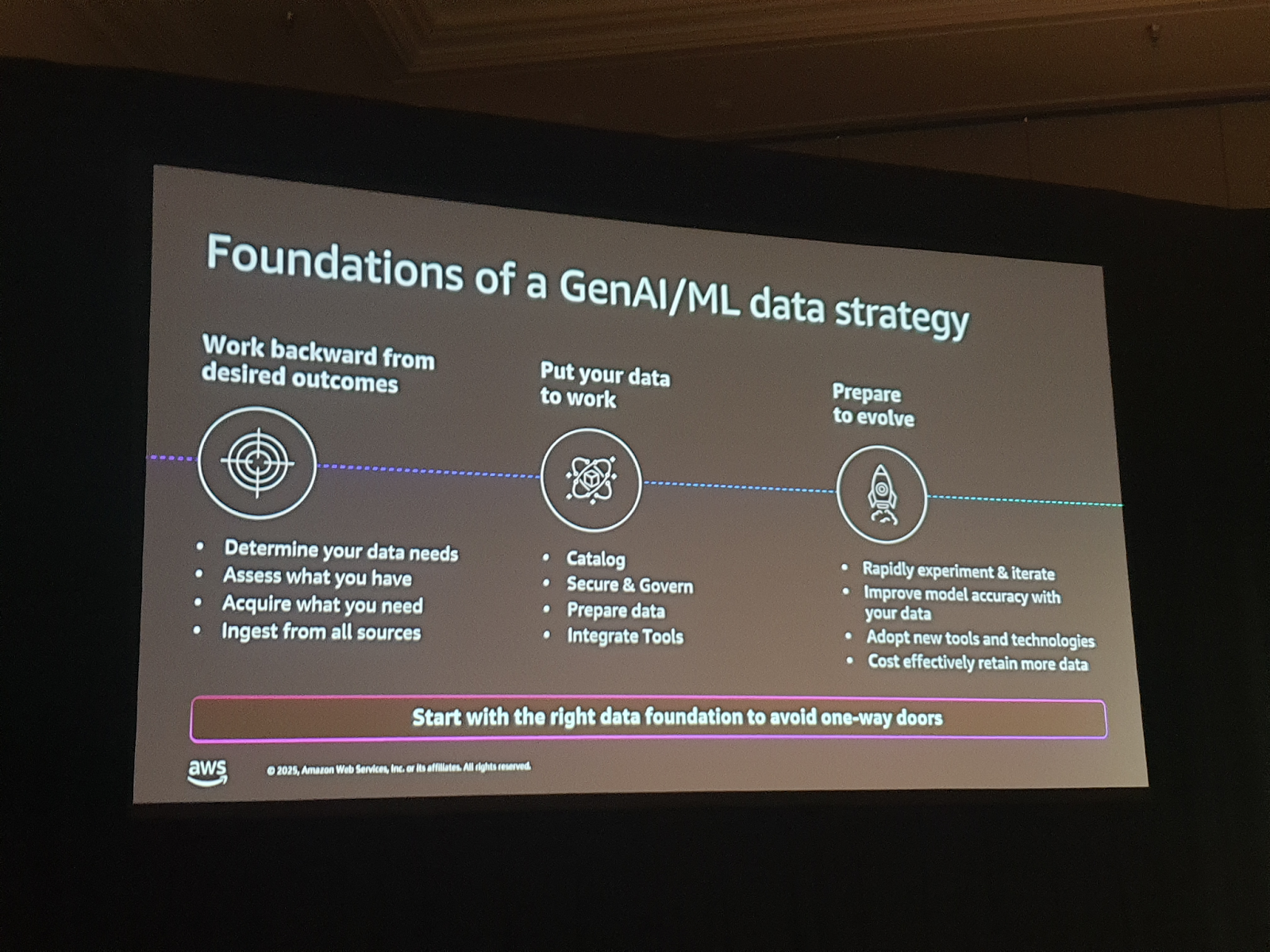

핵심 원칙 데이터 전략의 중요성

세션은 세 가지 핵심 원칙으로 시작했습니다. 첫째, 모든 조직에 데이터 전략이 필요합니다. 많은 프로젝트가 목표와 전략을 수립하지만 “스토리지가 실제로 어떻게 작동할 것인가”, “실패하면 어떻게 될 것인가”, “프로덕션에 진입하면 어떻게 작동할 것인가” 같은 질문에는 답하지 못합니다. 이러한 질문에 미리 답하면 나중에 훨씬 적은 문제에 직면합니다.

둘째, 고유한 데이터가 가치의 열쇠입니다. 기성 모델과 도구를 사용할 때는 스토리지 결정을 거의 내릴 필요가 없지만, 커스터마이징을 시작하면 스토리지 결정이 필요해집니다.

셋째, 최적의 스토리지 결정이 비용과 배포 시간을 줄입니다. 특히 중요한 인사이트는 때로는 더 비싼 스토리지가 전체 워크로드를 더 저렴하게 만든다는 것입니다.

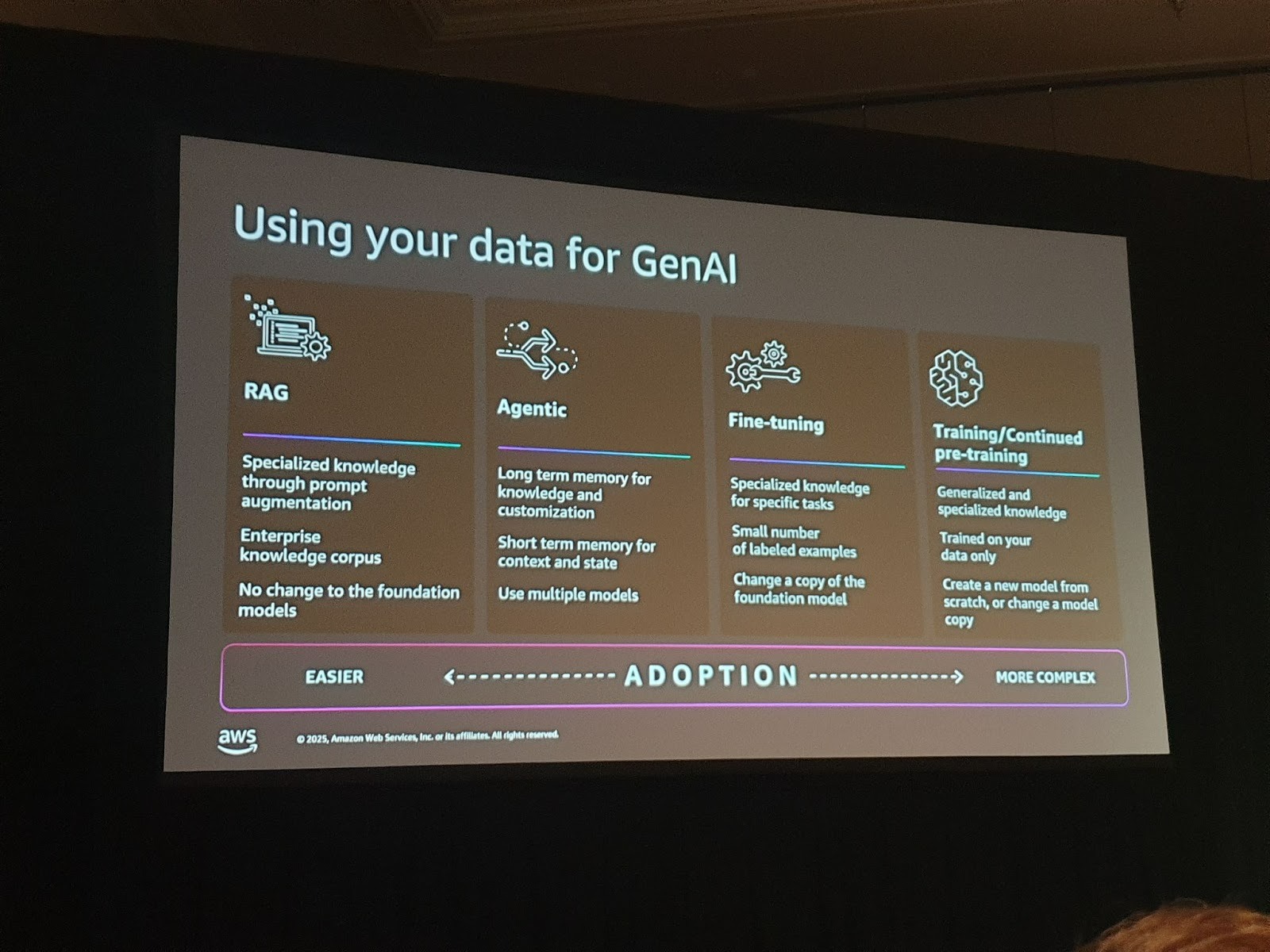

AI 워크로드별 스토리지 최적화 전략

RAG 워크로드

RAG는 가장 기본적인 GenAI 워크로드입니다. LLM은 훈련 시점의 컷오프 날짜가 있기 때문에 최신 정보와 고유한 데이터로 프롬프트를 보강해야 합니다. 스토리지 관점에서 S3를 기반으로 시작하는 것이 일반적입니다. 비즈니스 문서와 이미지가 이미 S3에 있는 경우가 많고 비용 최적화에도 유리하기 때문입니다.

벡터 데이터베이스 선택도 중요합니다. S3 Vectors는 최근 GA된 서버리스 벡터 스토리지로, 수백 밀리초의 성능과 인덱스당 수백 TPS를 제공합니다. 또한 대규모 내부 지식 베이스 구축 시 매우 비용 효율적입니다. 더 높은 성능이 필요하면 PostgreSQL과 pgvector를, 하이브리드 검색이나 복잡한 메타데이터 조합이 필요하면 OpenSearch를 사용할 수 있습니다.

에이전트 기반 접근 및 모범 사례

에이전트는 RAG, LLM, 메모리 관리를 모두 결합합니다. 메모리 관리가 핵심인데, 단기 메모리로는 체인 에이전트가 공유 메모리를 위해 파일 스토리지나 DynamoDB 같은 키-값 저장소를 사용할 수 있습니다. 시맨틱 캐싱(Semantic Caching)이나 프롬프트 캐싱을 적절히 활용하면 매번 LLM을 전체 호출하지 않아 비용을 크게 절감할 수 있습니다. 장기 메모리는 단기 메모리가 정리, 요약되어 임베딩으로 변환되고 벡터 형태로 저장됩니다.

관리형과 자체 관리 사이의 선택도 중요합니다. Bedrock Agents는 인프라, 보안, 도구 호출을 모두 관리해주는 완전 관리형 서비스입니다. EKS로 자체 관리하면 LangChain, LlamaIndex 같은 오픈소스 프레임워크를 사용할 수 있지만 인프라 관리 부담이 있습니다. Bedrock Runtime API를 활용한 자체 구현은 중간 옵션으로, 오픈소스 프레임워크를 유연하게 사용하면서도 모델 인프라는 AWS가 관리합니다.

파인튜닝과 트레이닝

성공 패턴은 명확합니다. 8노드 이하에서는 S3를 직접 사용하고, 8노드 이상의 분산 트레이닝 시에는 FSx for Lustre 같은 공유 파일 시스템이 필요합니다. S3를 데이터 레이크로 사용하고 필요할 때 FSx for Lustre를 캐시 계층으로 추가하는 전략이 효과적입니다.

FSx for Lustre는 S3 앞에 배치되어 데이터를 자동으로 가져오며, 클러스터가 꺼져 있어도 데이터를 미리 로드할 수 있습니다. 컴퓨팅과 데이터를 독립적으로 스핀업/다운할 수 있어 비용과 시간을 완전히 제어할 수 있습니다. 예외적으로 관리 편의성이 중요하거나 범용적인 파일 공유가 필요한 경우 EFS를 고려할 수 있지만, 고성능이 요구되는 대부분의 학습 환경에서는 S3와 FSx for Lustre 패턴을 사용합니다.

결론 및 소감

이 세션은 GenAI와 ML 워크로드를 위한 스토리지 선택이 단순히 기술적 결정이 아니라 전략적 결정임을 강조했습니다. 워크로드 유형에 따라 적절한 스토리지를 선택하면 성능은 물론 전체 비용을 크게 절감할 수 있습니다.

특히 인상 깊었던 점은 더 비싼 스토리지가 전체 워크로드를 더 저렴하게 만들 수 있다는 역설적인 진실입니다. FSx for Lustre 같은 고성능 스토리지를 적절히 사용하면 컴퓨팅 시간을 크게 줄여 전체 비용이 감소합니다. S3 Vectors의 등장으로 벡터 데이터베이스의 경제성이 완전히 바뀌었고, 서버리스로 무제한 확장이 가능하면서도 비용 효율적이어서 다양한 사용 사례를 가능하게 합니다.

관리형과 자체 관리 사이의 선택지도 명확했습니다. 빠르게 시작하려면 Bedrock Agents를, 더 많은 제어가 필요하면 EKS와 오픈소스를, 그 중간을 원하면 Agent for Bedrock Runtime을 선택하면 됩니다. 결국 어떤 접근 방식을 선택하든 S3 기반의 견고한 데이터 기반이 필요하다는 것이 핵심 메시지였습니다.